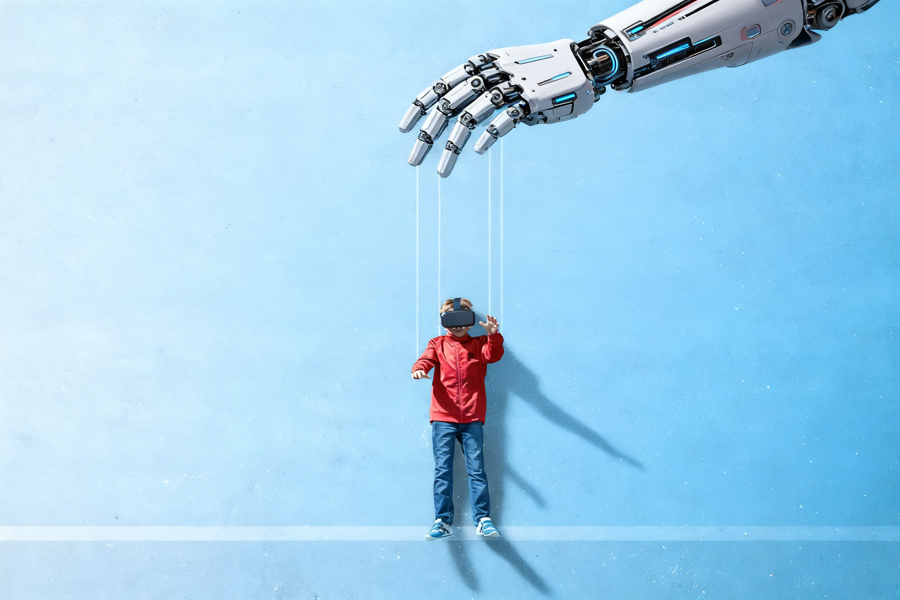

越来越多接头标明,当东谈主们对生成式AI器具的依赖突飞猛进,其想考才智和批判性想维水平可能正被减轻。不外,这种趋势并非不可逆转。

古希腊玄学家苏格拉底并不看重“好记性不如烂笔头”。这位举世着名的玄学家从未留住任何著述,他折服,对翰墨的依赖会龙套驰念力、减轻心智。不外,无数接头走漏,将信息写下来反而有助于驰念酿成,这一2400多年前的担忧似乎并未成真。

然而,苏格拉底对信息器具的警惕在今天又被拿起。越来越多心理学家、神经科学家和玄学家驱动牵记,ChatGPT等生成式AI器具可能会减轻东谈主类大脑的驰念和推理才智。

苏格拉底的不雅点论证主要靠玄妙的话语手段,而现代接头者的担忧则有简直证接头的基础。谈判接头发现,即即是受过专科教授的东谈主,在使用生成式AI器具时,也会在雅雀无声中减少使用批判性想维;如果在学习经过中高度依赖这些器具,还可能减轻大脑不同区域之间的招引,使信息更容易被淡忘。有东谈主曾向谷歌聊天机器东谈主Gemini发问:“AI是否会把东谈主类的大脑变恶果冻、驰念变成筛子?”它竟也承认“有这种可能”。

不外,情况并非余勇可贾。好多接头者以为,咱们也透彻不错将生成式AI升沉为提高通晓进展、增强想维才智的器具。好意思国纽约州立大学石溪分校的劳伦·里士满以为,东谈主工智能或然让东谈主类变笨,“问题大致在于咱们与它互动的格局不够机灵”。

那么,东谈主类在使用生成式AI时,究竟那儿出了问题?为更好诈欺这项工夫,咱们又该怎样调节?

通晓卸载越多,大脑使用越少

频年来,生成式AI已深度镶嵌东谈主们的生涯:心理调节师借助它来优化病例证明;学生靠它撰写论文;部分媒体机构也对它翻开大门。据报谈,好意思国财经新闻网站《生意内幕》已允许记者在草拟稿件时使用AI。

从某种深嗜深嗜上说,这些作念法延续了一个已特别千年历史的传统——通晓卸载,即借助器具或外部行动来减轻心理包袱。这一计谋在遍及生涯中随地可见。举例,咱们常会在大采购前写一份购物清单,而不是把要买的东西一齐记在脑子里。

多数情况下,通晓卸载确乎能提高驰念遵守与准确性,同期开释大脑资源,以处理更复杂的任务。里士满指出,这种计谋自己并无问题。但她与共事瑞安·泰勒在客岁发表的一篇综述中指出,通晓卸载也可能对通晓才智产生负面影响。

“当你把某件事情进行通晓卸载后,简直等同于在心理上将它删除。”里士满说,“联想一下,当你写好购物清单,却健忘把它带去超市,你还能记着几许需要购买的商品?”

这一不雅点得到了多项接头的救援。一项2018年的接头发现,在博物馆参不雅时,东谈主们用手机拍摄下展品后,反而更难记着展览施行,因为咱们已在意外志中把驰念任务“外包”给了手机。

这种步履可能会酿成一种轮回:通晓卸载越多,大脑就使用得越少;而大脑使用得越少,东谈主们就越倾向于赓续通晓卸载。“这种情况确乎会发生。”英国苏塞克斯大学玄学家安迪·克拉克说,1998年,他与现任职于好意思国纽约大学的玄学教学大卫·查尔莫斯无情了“延展通晓表面”,即除了咱们的心智以外,购物清单、相册等外部客体,也可作为通晓载体的延展。克拉克并未对这种延展作出价值判断,但他担忧,当东谈主们通过生成式AI和在线就业,将更多通晓卸载到汇集空间时,一朝遭受停电或汇集袭击,东谈主类将变得畸形脆弱。

通晓卸载还可能使驰念更容易受操控。2019年,加拿大滑铁卢大学进行了一项接头,接头东谈主员让志愿者驰念一组单词,并允许他们将单词打印出来以援手驰念。当接头者偷偷在打印版块中加入一个底本不存在的“搅扰词”时,志愿者普遍确信这个词本就在原始列表中。

苏格拉底对翰墨的警惕,就是一种对通晓卸载所带来的风险的担忧。而现时,生成式AI的出现使问题进一步复杂化。在一项2024年发表的接头中,好意思国宾夕法尼亚大学的希里·梅卢马德与尹振浩邀请1100名志愿者围绕“怎样收拾菜园”撰写漫笔。志愿者中的一部分东谈主使用传统网页搜索,另一部分东谈主使用ChatGPT。收尾走漏,使用ChatGPT的志愿者写出的文章通常更短,且事实援用更少。接头者以为,AI使学习经过变得愈加被迫,对知识的连系也更为疏忽。换言之,AI替咱们完成了信息整合,也让咱们失去了自主探索和发现的契机。

对AI越依赖,批判性想维越退化

对通晓卸载的担忧,最新神经科学接头提供了进一步救援。

在2024年夏天发表的一项接头中,好意思国麻省理工学院的娜塔莉娅·科斯米娜偏激团队让54名志愿者戴上脑电网络开荒,围绕诸如“的确的忠诚是否需要无条目救援”“遴荐过多是否会成为问题”等主题写文章。其中,第一组只可依靠自身知识和教授进行创作,第二组不错使用谷歌搜索引擎,第三组则可使用ChatGPT。

收尾走漏,在写稿经过中,使用ChatGPT的一组志愿者大脑不同脑区之间的招引性最低;透彻依靠自身知识的一组,脑区之间招引性最高;而使用浏览器搜索的一组则介于两者之间。

“确乎存在一种风险,这种简直无所不可的器具,大阳城(SuncityGroup)可能让东谈主们堕入爽直区,而这种爽直是有代价的。”科斯米娜还指出,大脑行为镌汰并不一定意味着通晓参与减少,要作出判断还需联结具体的步履操办。举例,在后续测试中,使用ChatGPT的志愿者更难准确复述我方的文章施行,这标明他们对写稿经过的参预进度较低。

{jz:field.toptypename/}此外,还有初步凭证标明,时常使用生成式AI与减少批判性想维的“通晓懒惰”之间存在关联。瑞士商学院的迈克尔·格尔利希近期评估了具有不同社会配景的666名参与者的AI使用习气和批判性想维才智。收尾走漏,17至25岁东谈主群的批判性想维得分比46岁以上东谈主群低了45%足下,而前者自述对AI的依赖进度比后者进步40%至45%。格尔利希以为,将这两项数据联结起来看,则可能示意着“过度依赖AI会减轻批判性想维才智”。

与此同期,好意思国微软公司与卡内基梅隆大学对319名知识型责任者,包括科学家、软件开发者、处治者和参谋人,张开了拜谒。收尾发现,对AI越有信心的东谈主,越倾向于承认我方在使用AI时减少了批判性想考。这与格尔利希无情的通晓懒惰风险相呼应。

不外,也有学者指示,现时下定论仍为时过早。好意思国肯尼索州立大学的亚伦·弗伦奇指出,格尔利希的接头只揭示了谈判性,并未细目两者的因果相关,且已有接头标明,青少年的批判性想维才智本就未透彻进修。

值得关怀的是,生成式AI甚而可能影响那些并赓续常使用它的东谈主。卡内基梅隆大学社会与决议科学系教学西蒙·德德奥与麻省理工学院博士后扎卡里·沃伊托维奇指出,东谈主们通常会看重某些步履背后所付出的勤恳,举例为成立相关而全心撰写的一封谈歉信,“如果咱们怀疑这些复杂的通晓任务是由AI来完成的,可能会更难信赖对方的由衷”。

东谈主类淹没原创,AI将“模子垮塌”

要想幸免上述问题,大致应该尝试重塑咱们与AI的相关,让它增强咱们的通晓参与,但这并防止易。格尔利希在一项新的接头中发现,即即是自以为具有较强批判性想维才智的东谈主,在勤勉明确辅导的情况下使用生成式AI,也容易滑向通晓懒惰。

但是,一朝有了辅导,情况就会变得不同。科斯米娜团队的补充接头提供了一个案例:接头东谈主员让那些开端仅凭自身知识写稿的志愿者,在第二轮锤真金不怕火中使用ChatGPT对归并篇文章进行修改。脑电数据标明,即便使用了AI,这些志愿者大脑的脑区之间依旧保执了较高的招引性。

“这阐明,如果东谈主们在使用AI之前先进行孤独想考,随后写出的文章在深嗜性、原创性和结构上皆会有权臣不同。”克拉克以为,这少量至关紧迫。

弗伦奇也执访佛不雅点。2024年,他与现今已故的共事J.P.希姆协作发表了一篇论文,指出正确使用生成式AI的作念法是将其看成增强对既有知识连系的器具,而不是视为替代学习与连系经过的偷懒捷径。

那么,怎样才算“用对AI”?克拉克建议,开端要镌汰对AI的信任度,“把它当成一个时而很有成见、时而却透彻跑偏的共事”。他还以为,在使用前想考越多,大脑“羼杂通晓”的进展就会越好。固然,有些时刻纵脱进行通晓卸载是合理的。举例,需要整合无数公开信息时,就不错让东谈主工智能先完成初步汇总,但仍需自行对汇总收尾进行核查。

格尔利希还指示,要警惕“锚定效应”——这种通晓偏差会让咱们在决议时过度依赖开首赢得的信息。这意味着,即便你在批判性地评估AI的回报,也可能已被它开端提供的信息带偏,从而妨碍的确的原创性想考。

应酬“锚定效应”的计谋之一是调节向AI发问的格局。举例,若要分析法国大改进的负面影响,不妨先让AI提供对于法国大改进及与之谈判的基步履实,再自行索取负面身分并进行证明,临了请AI指出论证中的破绽或提供反方不雅点。

使用AI的效果也因东谈主而异。对正在履历通晓才智下跌的东谈主来说,纵脱“卸载”反而可能有平允。东谈主的特性特色相似紧迫。对深爱想考的东谈主而言,与其让AI径直“投喂”谜底,不如让它来挑战你的连系。

大致,这些建议听上去好像仅仅一些学问,但克拉克以为,让更多东谈主意志到这少量至关紧迫。原因很疏忽:如果东谈主类期待AI提供一齐谜底,原创施行将徐徐减少,这最终可能让AI自己遭到反噬——空话语模子依赖东谈主类生成的施行进行教授,一朝原创施行短少,模子便可能堕入以自身产出的数据反复教授的轮回中,不仅质地徐徐镌汰,还会丧失创造力。克拉克将这种风险称为“模子垮塌”,“因此,确保东谈主类赓续创造出新的、深嗜的施行,有着躬行的现实利益考量”。

换言之,这场东谈主与AI之间的互动,从来不是单向的。咱们牵记AI让东谈主变笨,但当东谈主类过度依赖AI,也可能会反过来拉低AI的才略。